Artikel "Efficient Request Queueing – Optimizing LLM Performance"

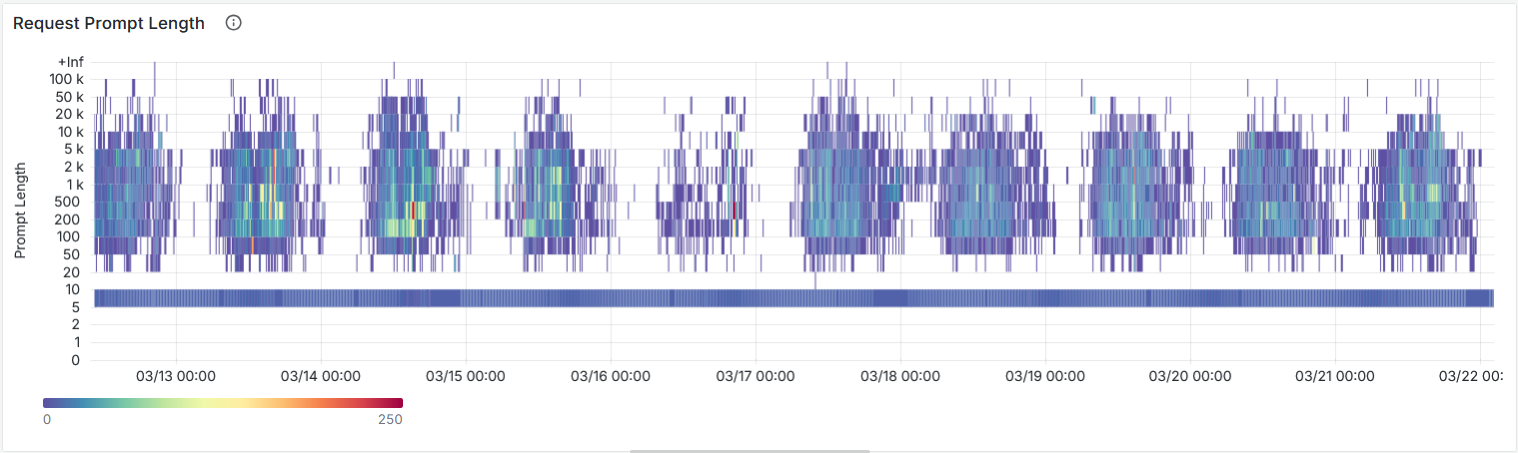

Large Language Models für mehrere Anwendungen und Nutzerinnen und Nutzer parallel bereitzustellen ist anspruchsvoll, da diese um begrenzte GPU-Ressourcen konkurrieren. Im ersten von drei Artikeln befasst sich unser Kollege Benjamin Merkel mit typischen Herausforderungen bei der Priorisierung von User-Anfragen und diskutiert Fair-Scheduling-Strategien auf Basis von Backend-Metriken als mögliche Lösung.

Hier können Sie den vollständigen Artikel "Efficient Request Queueing – Optimizing LLM Performance" lesen.